Jak utworzyć rozproszony workload inferencyjny

Ta sekcja wyjaśnia, jak wdrożyć rozproszony workload inferencyjny za pomocą interfejsu NVIDIA run:ai UI oraz CLI.

Rozproszony oznacza pojedynczy workload dostępny pod jednym adresem URL endpointu, ale rozłożony na wiele GPU.

Należy pamiętać, że workloady inferencyjne podlegają limitom (quota) projektu. Domyślnie mają przypisany priorytet

very-high, co oznacza, że są workloadami niepreemptowalnymi. Workloady inferencyjne nie mogą przekraczać limitu

quota przypisanego do projektu.

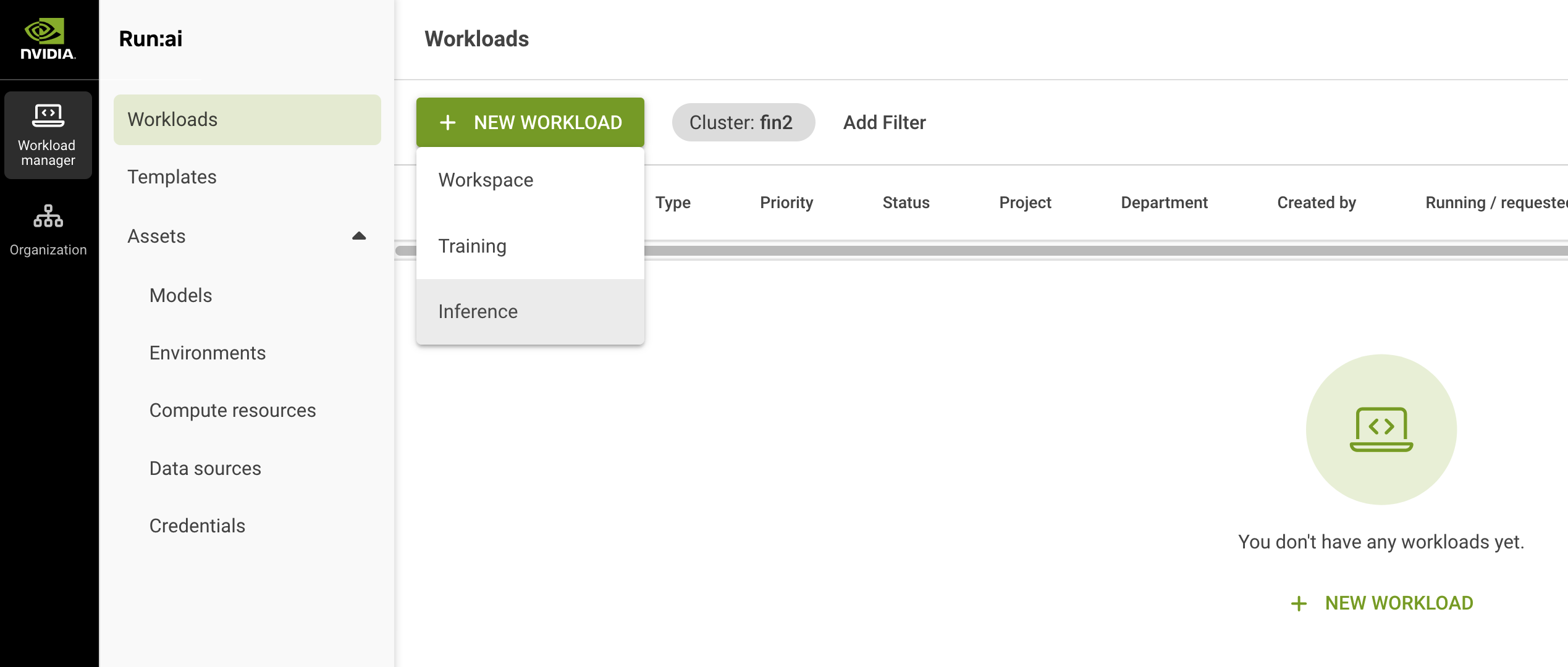

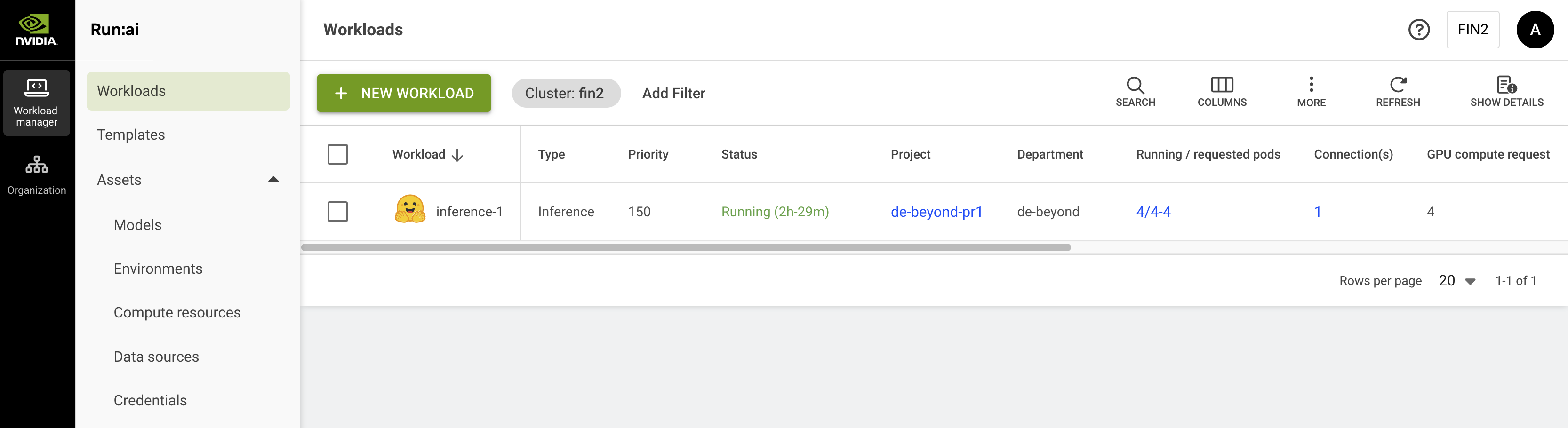

W interfejsie run:ai przejdź do zakładki Workload manager > Workloads.

Kliknij NEW WORKLOAD i z listy rozwijanej wybierz Inference.

Wybierz projekt, w którym chcesz wdrożyć inferencję.

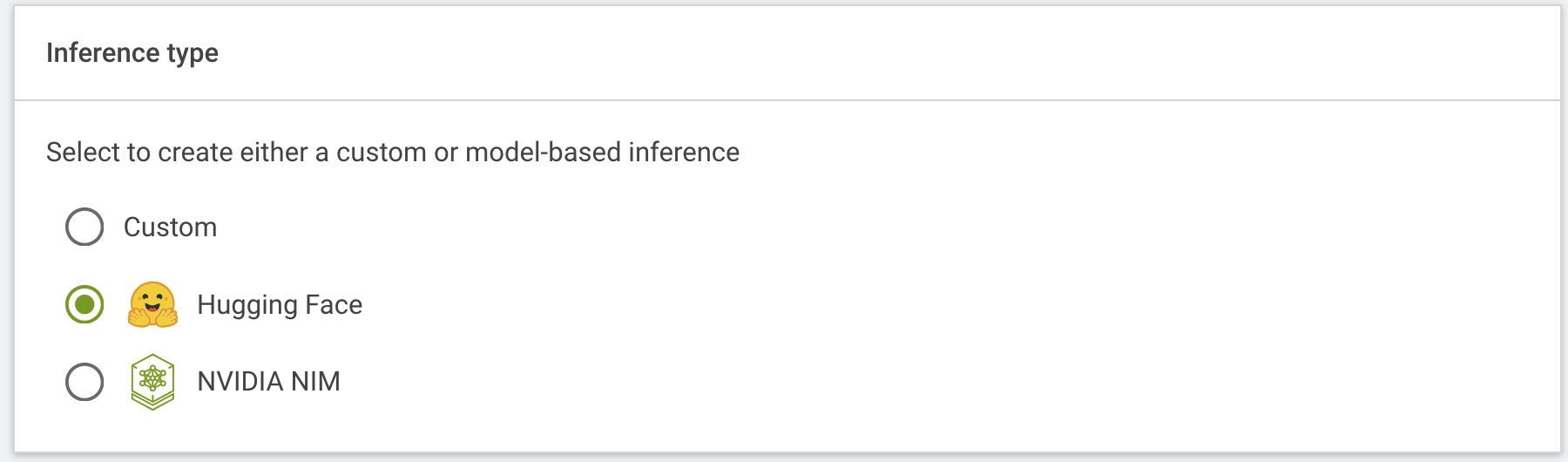

Wybierz typ inferencji: - Custom – jeśli chcesz wdrożyć własny model lub inny model niż LLM - Hugging Face – jeśli chcesz wdrożyć model z Hugging Face - NVIDIA NIM – jeśli chcesz wdrożyć model z NVIDIA NIM

W tym samouczku wdrożymy model z Hugging Face:

Wprowadź nazwę workloadu i kliknij CONTINUE.

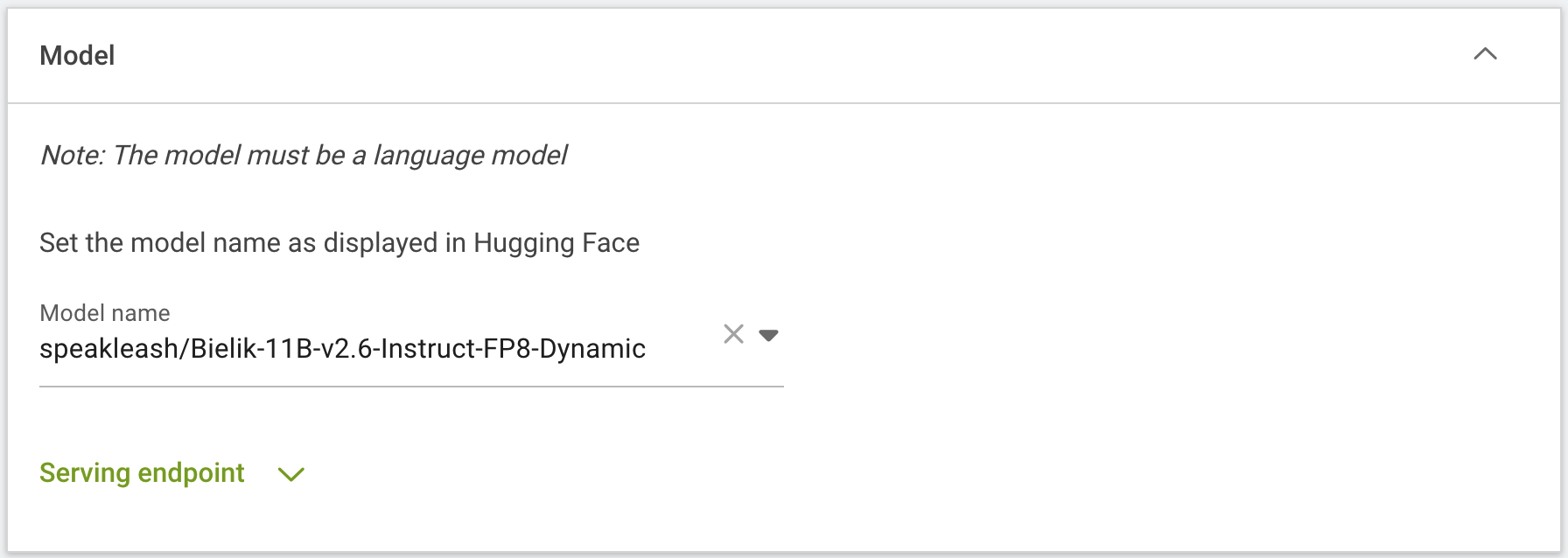

Na następnej stronie, w sekcji Model, podaj nazwę modelu dokładnie tak, jak jest wyświetlana w Hugging Face:

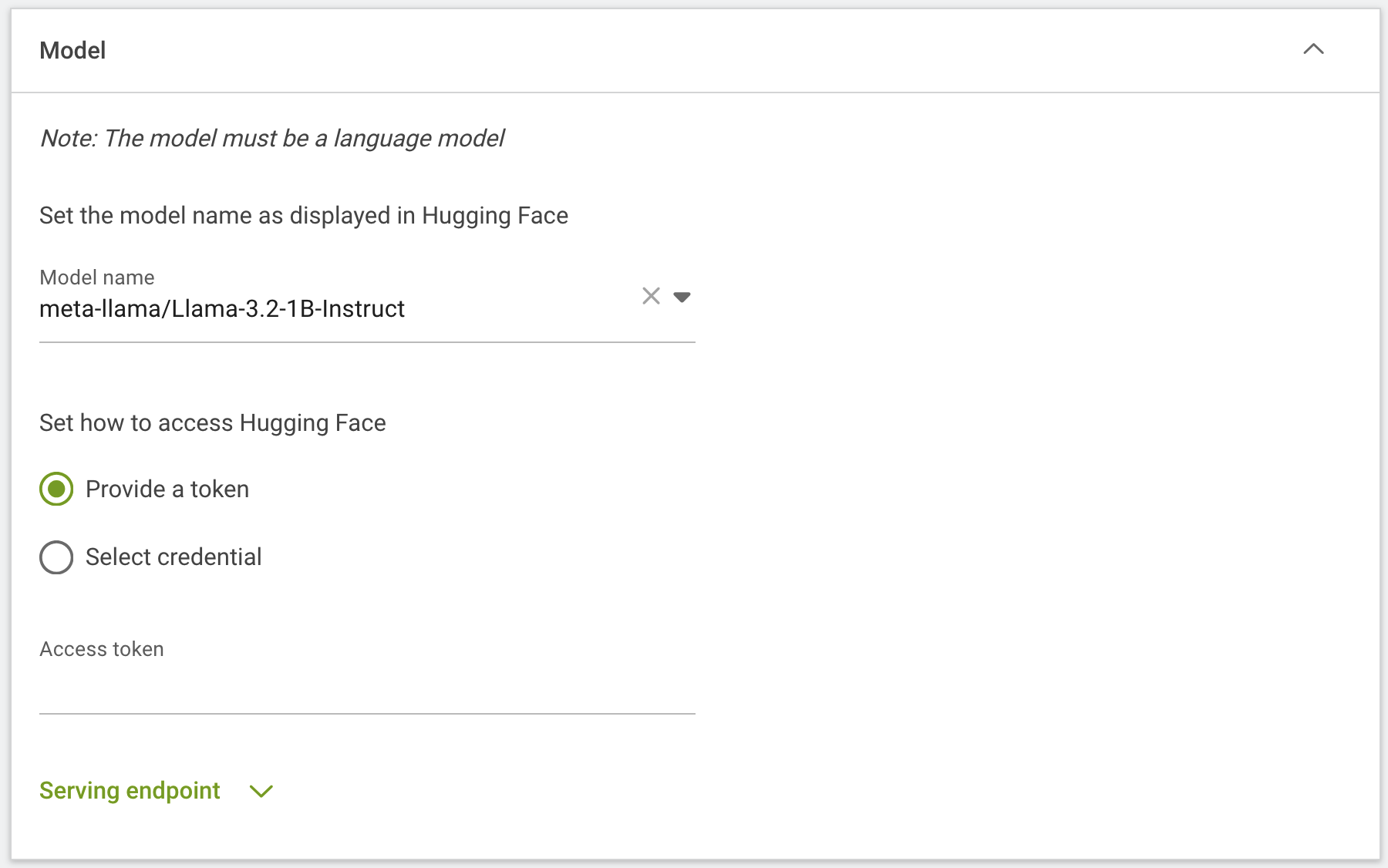

Jeśli model wymaga tokenu dostępu, możesz podać go bezpośrednio na tym etapie lub wybrać wcześniej dodany z zasobów poświadczeń (credential assets):

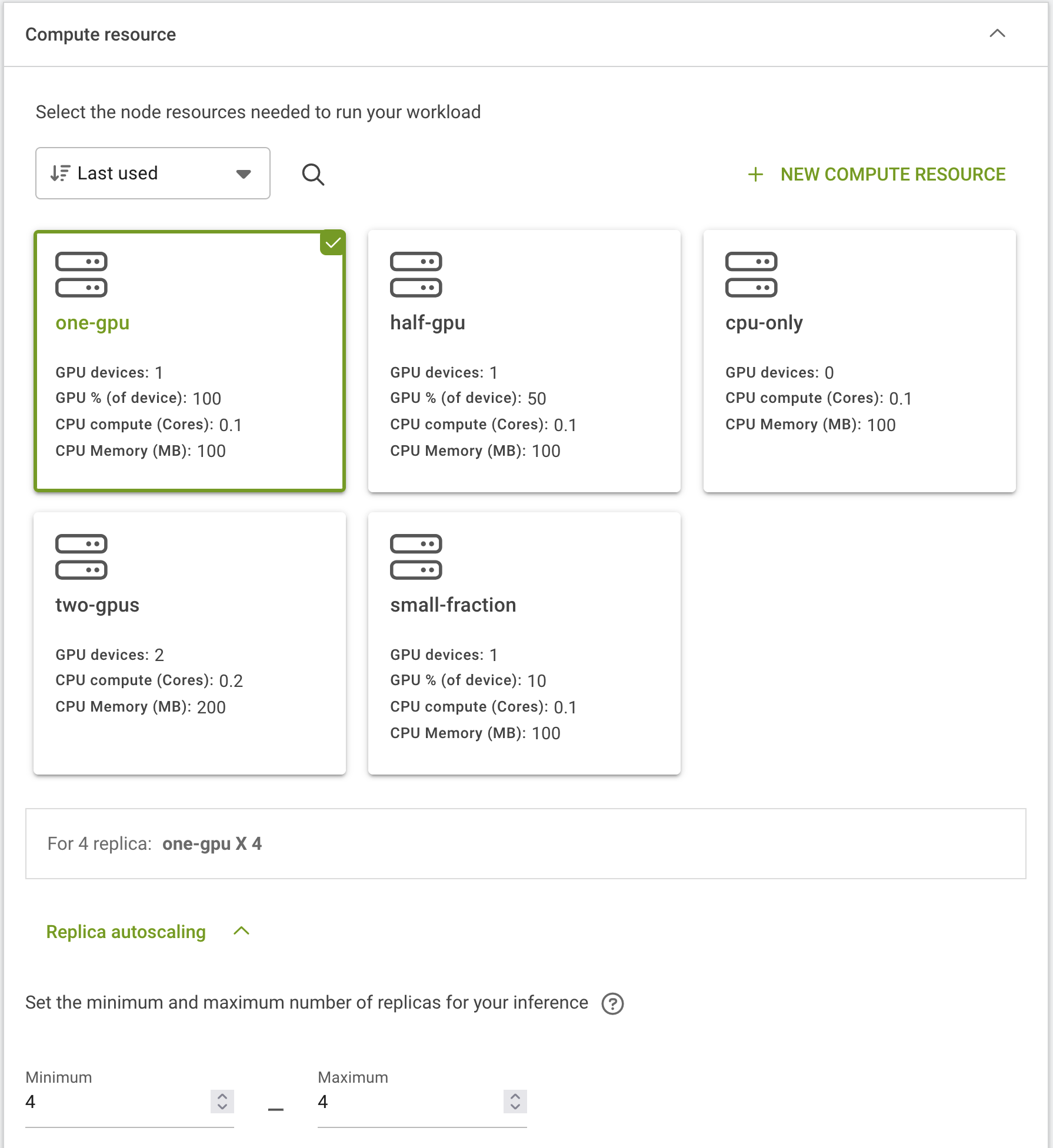

Wybierz frakcję GPU. Aby wdrożyć rozproszoną inferencję, na przykład na 4 GPU, gdzie 1 GPU = 1 replika modelu, wybierz frakcję one-gpu, a w sekcji Replica autoscaling ustaw 4 jako minimalną i 4 jako maksymalną liczbę replik.

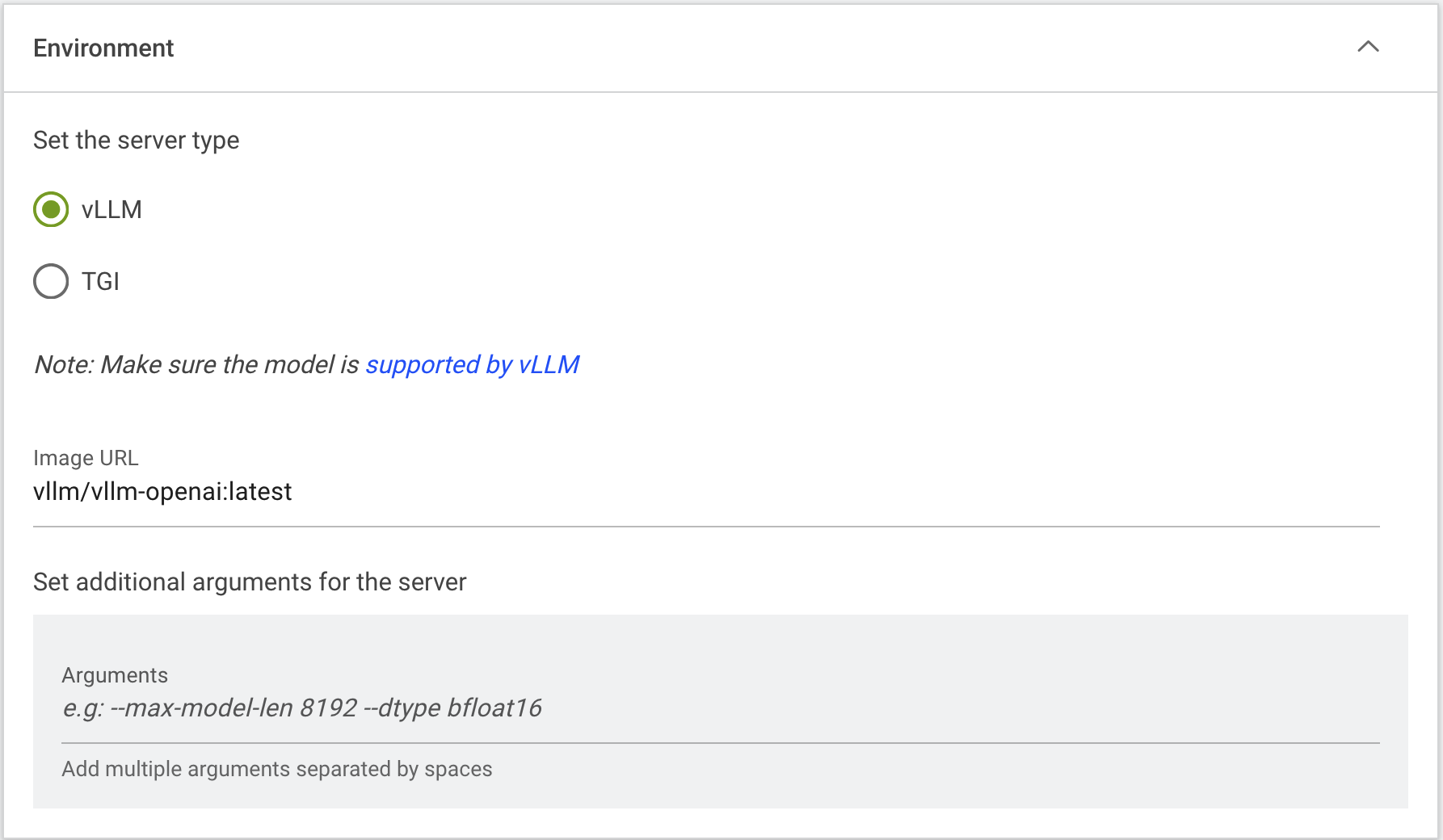

W sekcji Environment wybierz serwer inferencyjny i, jeśli to konieczne, ustaw dodatkowe argumenty:

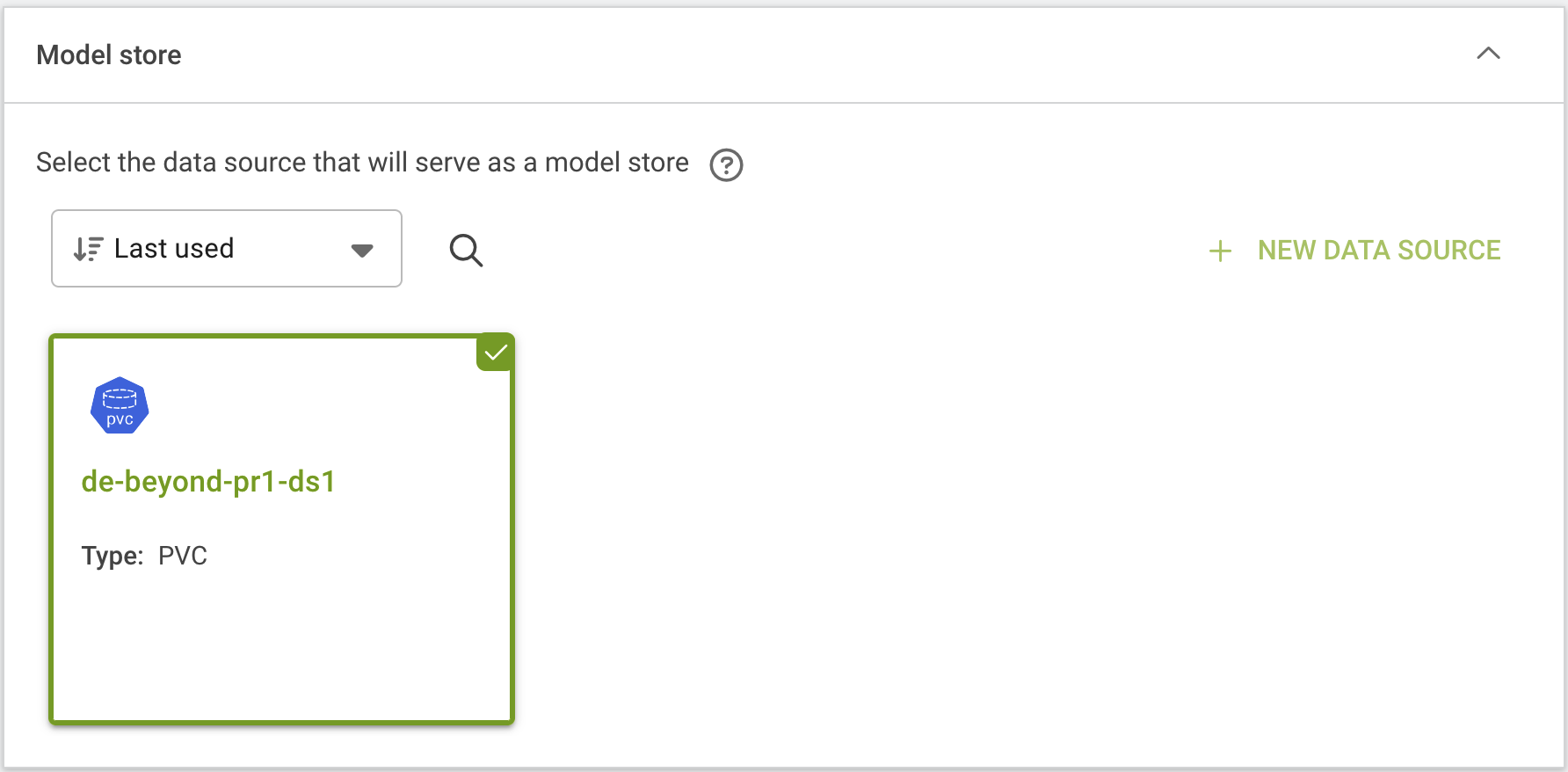

W sekcji Model store wybierz źródło danych – na przykład PVC. Jeśli nie wybierzesz tutaj źródła danych, model zostanie wdrożony na lokalnym dysku węzła klastra. Zaleca się użycie źródła danych PVC dla rozproszonej inferencji, aby przyspieszyć wdrażanie replik modelu – jest to szczególnie istotne w sytuacji, gdy workload zostanie ponownie wdrożony na innym węźle.

Kliknij CREATE INFERENCE, aby rozpocząć wdrażanie.

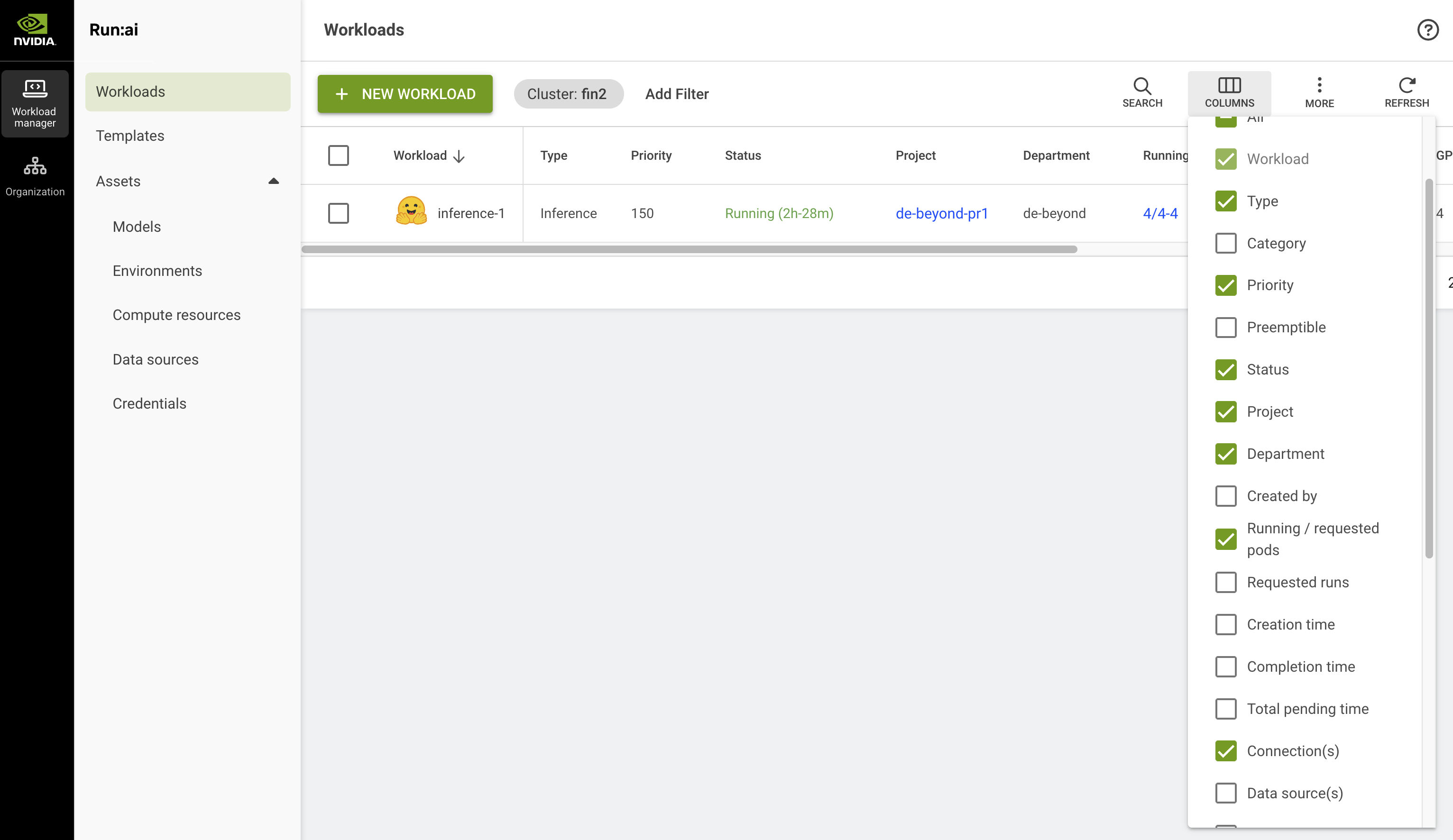

W zależności od rozmiaru modelu wdrożenie może potrwać kilka minut. Gdy workload będzie uruchomiony, możesz zacząć z niego korzystać.

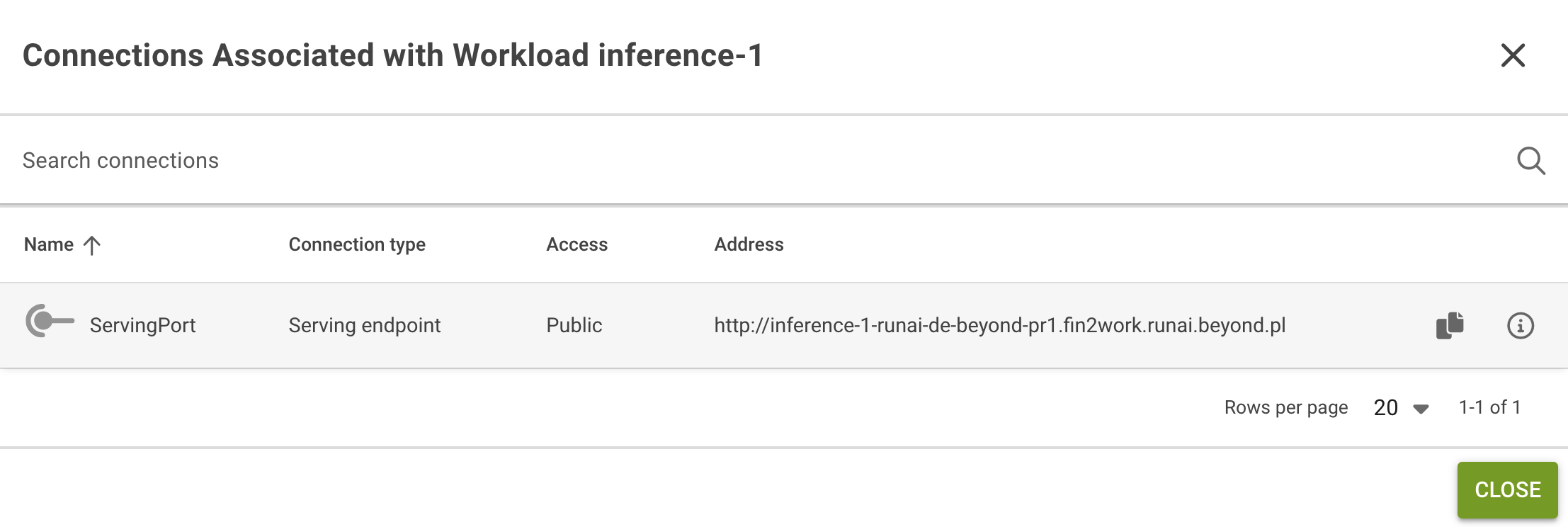

Endpoint workloadu znajdziesz w kolumnie Connection(s). Jeśli nie jest widoczny, musisz dodać go za pomocą ikony COLUMNS:

Endpoint w run:ai pojawi się z protokołem http — aby uzyskać do niego dostęp z internetu, należy zmienić go na https.