Jak utworzyć workload inferencyjny autoskalowany od 0

Ta sekcja wyjaśnia, jak skonfigurować autoskalowanie workloadów inferencyjnych od 0 replik.

Autoskalowanie od 0 replik może być przydatne, jeśli nie musisz przez cały czas alokować zasobów GPU dla workloadu inferencyjnego, a jedynie wtedy, gdy są one potrzebne na żądanie i spełnione zostaną określone warunki.

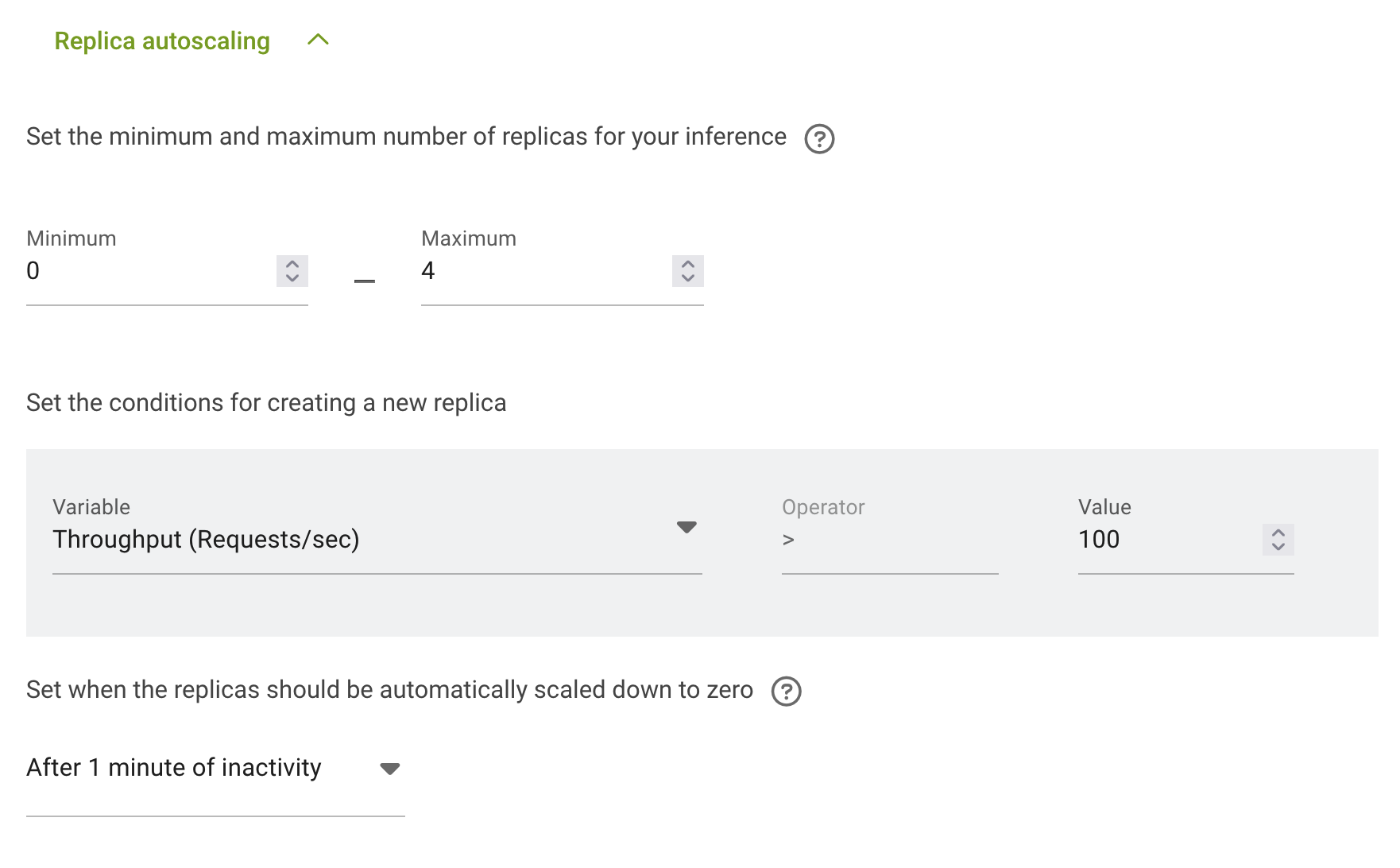

Konfiguracja odbywa się w sekcji Replica autoscaling. Aby przejść do tej sekcji, możesz skorzystać z instrukcji Jak wdrożyć rozproszony workload inferencyjny.

Najpierw należy ustawić minimalną liczbę replik na 0 – w takim przypadku żadne zasoby GPU nie będą alokowane.

Następnie należy ustawić maksymalną liczbę replik – liczbę replik po pełnym autoskalowaniu.

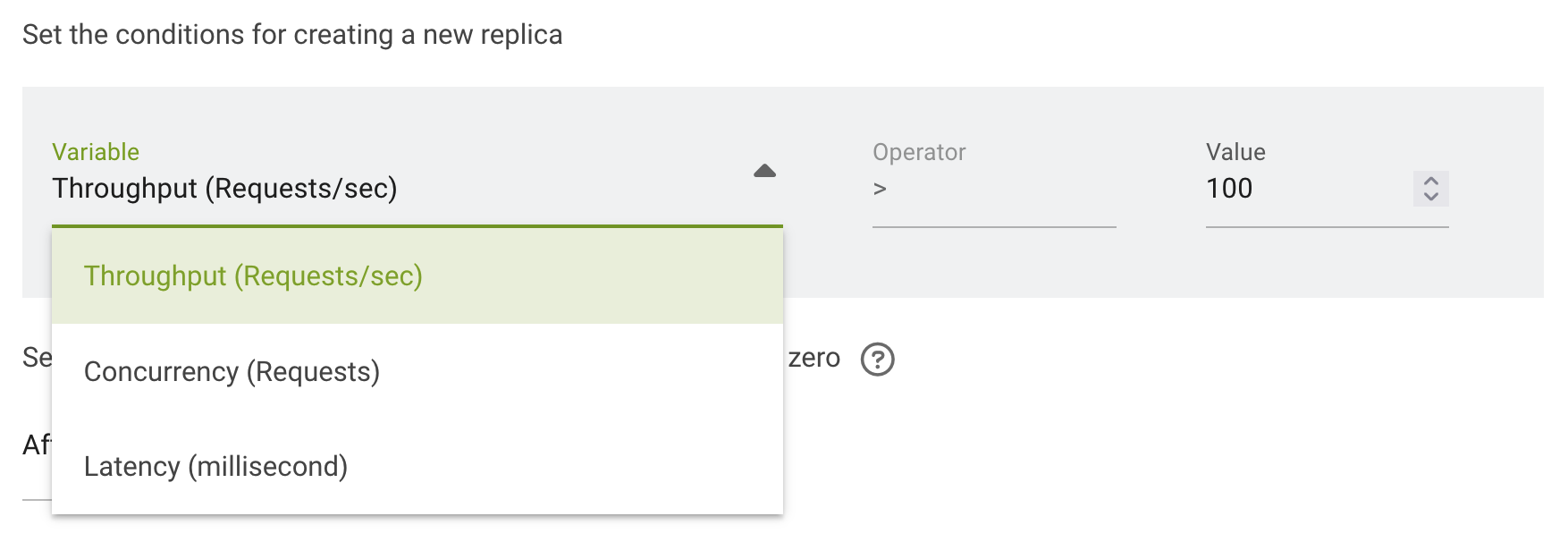

Kolejnym krokiem jest skonfigurowanie warunków, przy których autoskalowanie zostanie uruchomione. W run:ai dostępne są 3 opcje: - Throughput (żądania/sek.) - Concurrency (liczba żądań) - Latency (milisekundy)

Dla wybranej opcji należy ustawić odpowiednią wartość:

Skalowanie w górę i w dół będzie odbywać się automatycznie zgodnie z ustawionymi warunkami.

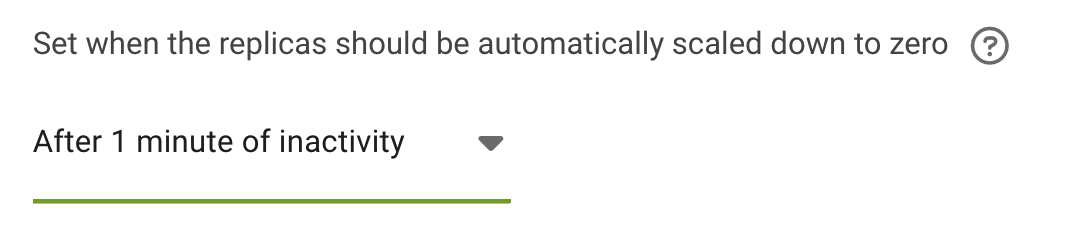

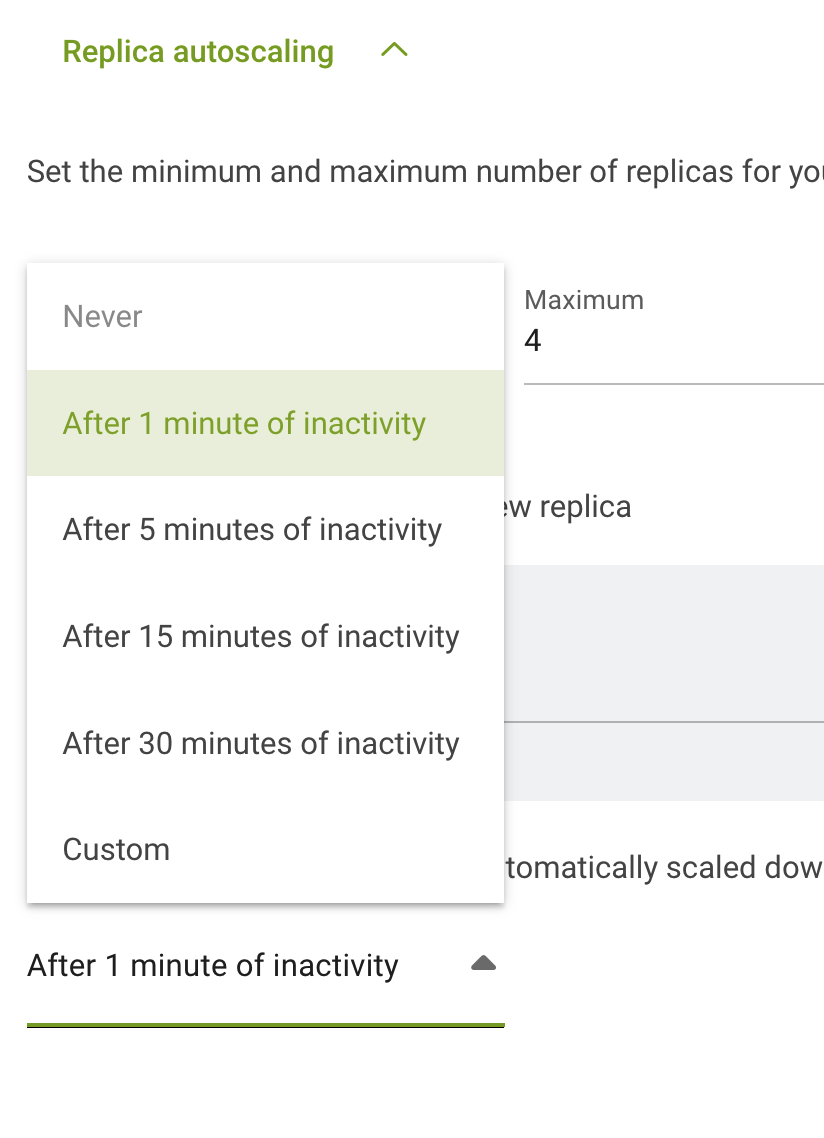

Ostatnim elementem konfiguracji jest określenie, kiedy repliki powinny być automatycznie skalowane w dół do zera:

Twój workload inferencyjny jest teraz skonfigurowany do skalowania od zera replik. Pierwsza replika zostanie utworzona po pierwszym żądaniu, a skalowanie do kolejnych replik rozpocznie się po spełnieniu warunków autoskalowania.